1

了解robots文件

1、什么是robots文件?

robots文件用于指定spider在网站上的抓取范围,在文件中可以声明网站中不想被搜索引擎抓取或指定被抓取的资源。

2、robots.txt文件怎么写?

文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示:"<field>:<optional space><value><optionalspace>"

在该文件中可以使用#进行注解,具体使用方法和UNIX中的惯例一样。

该文件中的记录通常以一行或多行User-agent开始,后面加上若干Disallow和Allow行,详细情况如下:

robots文件具体详情

User-agent:该项的值用于描述搜索引擎robot的名字。Disallow:该项的值用于描述不希望被访问的一组URL,这个值可以是一条完整的路径,也可以是路径的非空前缀,以Disallow项的值开头的URL不会被 robot访问。

Allow:该项的值用于描述希望被访问的一组URL,与Disallow项相似,这个值可以是一条完整的路径,也可以是路径的前缀,以Allow项的值开头的URL 是允许robot访问的。

如果"/robots.txt"不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。

说明:百度会严格遵守robots的相关协议,请注意区分您不想被抓取或收录的目录的大小写,百度会对robots中所写的文件和您不想被抓取和收录的目录做精确匹配,否则robots协议无法生效。

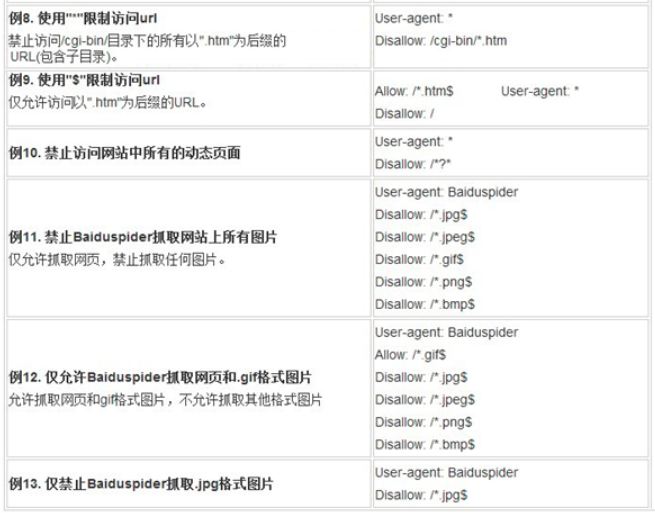

robots.txt文件举例

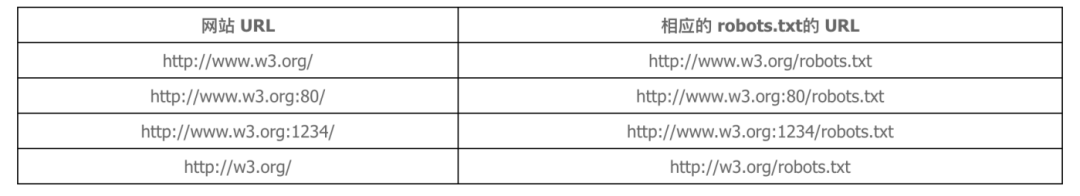

3 、robots.txt文件放在哪里?

robots.txt文件应该放置在网站根目录下。网站对应robots文件的URL:

2

如何使用【Robots】工具

1 、【Robots】工具的作用?

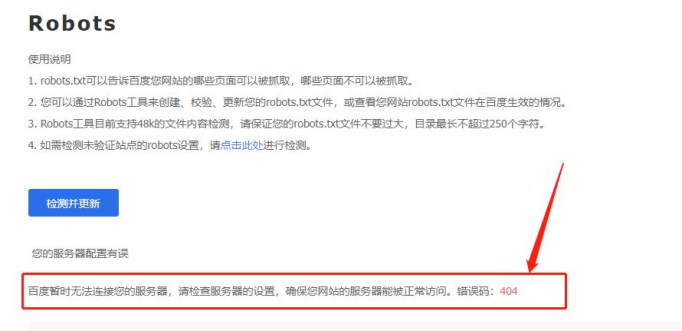

站长可以通过搜索资源平台【Robots】工具来创建、校验、更新robots.txt文件,或查看网站robots.txt文件是否成功生效的情况。

2 、使用【Robots】工具的注意事项?

【Robots】工具目前支持48k的文件内容检测。同时请保证网站的robots.txt文件不要过大,目录最长不超过250个字符。robots文件更新和提交后,百度蜘蛛不是立即调整停止/开放抓取的,搜索引擎需要逐渐完成robots.txt的更新。

3 、robots.txt已设置禁止百度收录网站的内容,为何仍出现在搜索结果中?

可能存在以下问题:(1)robots文件不能有效访问。站长可以在资源平台-【Robots】工具查看robots文件的访问情况。

(2)文件暂未生效。robots文件在结果中生效一般需要1-2周,可以关注。

4 、【Robots】工具校验提示解读?

可能出现以下情况:显示错误码404,robots文件可能无法被访问。

显示错误码301,robots文件可能存在跳转。

显示错误码500,robots页面访问失败。

以上情况时,建议自查robots文件情况针对性优化后,重新提交校验。

5 、robots文件误封禁,如何处理?

(1)修改robots文件,封禁改为允许。(2)在搜索资源平台检测并更新robots文件,若显示抓取失败,可以多尝试点击几次,触发蜘蛛抓取站点。

(3)关注【抓取频次】数据情况,可以适当调整抓取频次。

(4)可以使用【链接提交】,主动提交相关资源链接。

来源:百度搜索资源平台